Il costo della tossicità - editoriale

Perché tutti gli sviluppatori cercano di porre un freno alla tossicità in gioco?

Ci sono ottime possibilità che chiunque abbia giocato a un qualsiasi titolo multiplayer nell'ultimo decennio si sia imbattuto in ostilità, trash-talk e aggressività da parte di estranei, sia in forma scritta che verbale.

Com'è lecito aspettarsi, questa ostilità colpisce in modo sproporzionato le minoranze delle comunità online: donne, persone di colore, persone LGBTQ. L'uso comune di insulti, urla e inviti al suicidio, crea uno spazio inospitale per i giocatori vittime di questi comportamenti.

Insulti. Rabbia. Delusione.

Non è certamente un problema facile da risolvere, ma non è neanche una inevitabilità con cui dobbiamo convivere. C'è ancora la percezione nelle comunità di giocatori che l'abuso online sia un dato di fatto, che sia ineluttabile come andrebbe di moda dire oggi; che gli animi accesi siano parte integrante del godimento di un gioco e che chiunque si lasci influenzare da ciò che viene detto online, avrebbe bisogno di "imparare a stare al mondo" o andarsene.

Queste risposte sono costantemente utilizzate per respingere il dialogo con coloro che vorrebbero parlare delle proprie esperienze negative, il che aiuta solo i giocatori abusivi a essere ancora più tollerati.

Per gran parte della sua storia, giocare online è stato un free-for-all di dimensioni globali, una distesa senza leggi che troppo spesso ha deluso quei giocatori che cercavano un ecosistema in cui divertirsi dopo una giornata di lavoro o di studio, senza incorrere in ostilità da parte dei propri compagni e avversari. Ogni meccanismo ha bisogno di una manutenzione periodica per operare correttamente, quindi non dovrebbe sorprenderci che molti leader del settore siano finalmente pronti a smettere di ignorare la grande macchina che genera tossicità, e ad adottare approcci innovativi per ripararla.

La creazione della Fair Play Alliance

La necessità di abbassare il livello di tossicità del proprio gioco non è un problema limitato a poche software house. Anzi, è così diffuso che nel 2018 alcune tra le software house più attive negli studi della tossicità hanno deciso di fare fronte comune e affrontare assieme il problema.

La Fair Play Alliance è una coalizione formata da oltre 100 diverse società, tra cui Riot Games, Blizzard Entertainment, Twitch, CCP ed Epic Games, che mira a condividere ricerche e lezioni apprese intorno alle comunità di gioco nella speranza di ridurre il comportamento distruttivo di queste ultime.

L'obiettivo è quello di creare un database degli standard di comportamento degli utenti e una comprensione comune dei problemi che causano un comportamento inadeguato nelle comunità online.

La speranza è quella che gli sviluppatori possano far leva sulle nozioni imparate ed abbassare la tossicità del proprio gioco fin dalla fase di design dello stesso.

Utilizzare il Game Design come strumento contro la tossicità

Quando in un ambiente sociale in cui siamo abituati a operare è utilizzato il solo linguaggio verbale, ci troviamo di fronte a un grosso problema. Nel mondo fisico, le convenzioni sociali e il linguaggio del corpo ci guidano attraverso l'interazione umana quotidiana. Gran parte della nostra comunicazione avviene non verbalmente, offrendo al nostro cervello una più ampia gamma di dati da interpretare.Per capirci, solo il 7% della nostra comunicazione è verbale, il 93% è invece affidato a postura (55%) e tono di voce (38%).

Il primo passo è riconoscere due verità scomode: il contesto gioca un ruolo fondamentale, e le nostre parole possono assumere sfumature di grigio in assenza del 93% del loro contesto.

Anche il linguaggio volgare può giocare un ruolo positivo in una comunità a seconda del contesto. Un gioco online per bambini ha esigenze diverse da un gioco per adulti, quindi non esiste una soluzione adatta a tutti. Quindi quali sono le nostre opzioni?

I metodi per affrontare la gestione della comunità generalmente rientrano in una delle due categorie: punire i comportamenti negativi o ricompensare quelli positivi. Le tipiche risposte al cattivo comportamento includono messaggi di avvertimento, restrizioni parziali da alcune caratteristiche del gioco (il non poter parlare in chat per un tot di partite, ad esempio) e, come misura finale, sospensioni temporanee o permanenti.

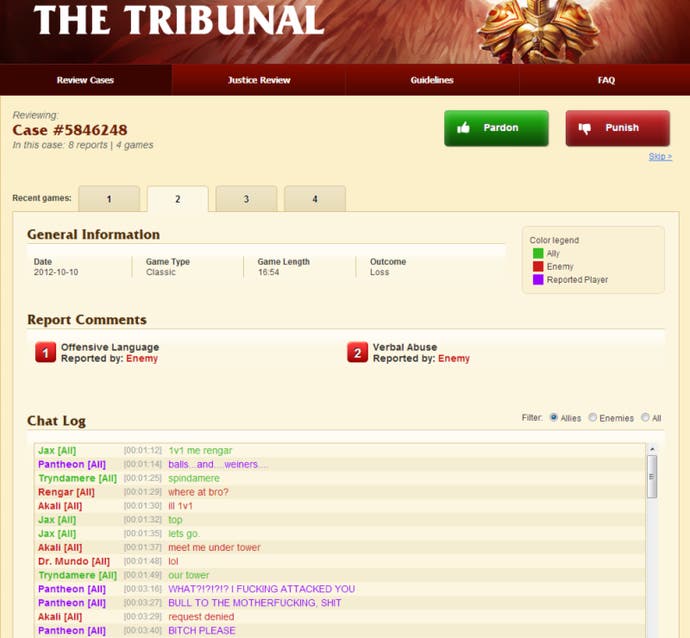

L'esempio più famoso è il Tribunale di League of Legends, un tentativo di affidare alla community stessa la possibilità di elargire punizioni e sospensioni.

Nel 2015 il Lead Game Designer dei sistemi sociali, Jeffrey Lin, ha parlato del successo del Tribunale del gioco, che ha dato l'opportunità di votare quali comportamenti erano inaccettabili e punire i trasgressori di conseguenza. L'abuso verbale è diminuito di oltre il 40%, e il 91,6% dei giocatori negativi ha cambiato il suo comportamento e non ha mai commesso un altro reato, anche dopo una sola sanzione.

Un servizio votato dai giocatori come il Tribunale ha però due grossi inconvenienti, che sono molto difficili da evitare e che hanno portato alla rimozione del sistema:

- È lento e inefficiente. Le revisioni manuali richiedono l'inserimento dei log delle chat nel sito, l'attendere di ottenere risposte da abbastanza giocatori e il decidere una punizione sulla base di queste risposte. Come metro di paragone, l'attuale sistema automatizzato di Riot Games può invece infliggere penalità in meno di 15 minuti dall'invio della segnalazione.

- È a volte enormemente inaccurato, soprattutto in quanto c'era una ricompensa in valuta di gioco per il "successo" nelle punizioni, che portava a una faziosità innata all'interno del sistema, facendo propendere i giocatori alla sospensione dei propri compagni di gioco.

Un altro esempio degno di nota è la recente mossa di League of Legends di offrire skin esclusive agli utenti che non hanno ricevuto sospensioni nell'ultimo anno attraverso il sistema Onore.

Questo sistema, attivato nel 2018, ha connesso la distribuzione di loot box gratuite al proprio livello di Onore, legando a doppia mandata il proprio comportamento con l'ammontare di ricompense che si ottengono, arrivando a elargire milioni di loot box e skin esclusive per coloro che hanno raggiunto e mantenuto livelli di Onore eccezionali.

Ha anche creato un chiaro percorso di redenzione per i giocatori che hanno commesso errori in passato. L'errore saltuario o la sfuriata improvvisa possono capitare a tutti, soprattutto in condizioni di stress, e offrire un modo chiaro e semplice per tornare ad essere ricompensati è basilare nella conversione degli utenti tossici in utenti con comportamenti positivi.

Questo modello di rinforzo positivo pavloviano sta guadagnando rapidamente trazione nel settore, basti guardare alla soluzione simile messa in atto da Overwatch col suo sistema di endorsement.

Il sistema include feature con lo scopo di incoraggiare un comportamento positivo. Ad esempio, è presente un messaggio di ringraziamento per tutte le segnalazioni relative alla tossicità che dice ai giocatori che i loro messaggi sono stati ricevuti dalla compagnia, c'è un'opzione "in cerca di gruppo" per aiutare i giocatori a trovare compagni di squadra con stili di gioco simili e penalità per i giocatori colpevoli di aver lasciato le partite in corso.

Un data point che ha esaminato il numero di segnalazioni per tossicità per partita ha indicato che c'era stata una riduzione del 40% nelle partite in cui veniva rilevato un comportamento tossico (fonte: Natasha Miller, Blizzard Entertainment).

Successivamente, Blizzard ha riferito che le segnalazioni per abusi verbali sono calate dal 15% al 30%, a seconda della piattaforma di gioco. Ancora lungi dall'essere una situazione perfetta, è comunque la prova che incoraggiare il buon comportamento funziona e, più in generale, che ci sono misure che le aziende possono prendere per rendere le loro comunità meno tossiche e più accoglienti.

Non molto tempo dopo sono arrivate le sospensioni istantanee di mezz'ora di Ubisoft ai giocatori di Rainbow Six Siege colti a digitare insulti in chat. Un secondo reato porta a una sospensione di due ore e una terza porta a un'indagine ufficiale che può comportare un divieto permanente.

Alcuni giochi hanno invece deciso di affrontare il problema alla base, eliminando la possibilità di comunicare liberamente col proprio avversario, se non attraverso emote predefinite e limitando quindi la complessità dei messaggi che possono venire inviati al proprio interlocutore.

Hearthstone e Clash Royale sono gli esempi più famosi di questo stile, in cui la comunicazione col proprio avversario si riduce a una scelta molto limitata di emote, che nel caso di Hearthstone è particolarmente interessante perché è il primo gioco Blizzard dove la possibilità di scrivere in chat è stata rimossa del tutto.

Va fatto notare che nemmeno una soluzione così drastica si è poi rivelata essere completamente efficace: ironicamente la community trova sempre il modo di comportarsi in maniera tossica, e mentre su Hearthstone l'emote scelto a questo scopo è stato il "Sorry", spesso spammato quando si sta per vincere la partita, su Clash Royale è il "Re in lacrime" a farla da padrone.

Tutte queste soluzioni richiedono investimenti sostanziosi di tempo, risorse, denaro. Dedicare interi team alla soluzione di questa problematica è un grosso investimento per qualsiasi software house, ed è lecito pensare che questi sforzi non vengano fatti solo per ottenere un ritorno d'immagine.

Perché alle compagnie interessa così tanto risolvere questo problema?

Storicamente la tossicità nei videogiochi prende forma in comportamenti rudi nei confronti dei nuovi giocatori, insulti razziali, omofobia e sessismo, che costituiscono una parte significativa della comunicazione, in particolar modo nei giochi free-to-play, competitivi e che richiedono lavoro di squadra.

Sebbene una comunità tossica potrebbe non essere l'unico fattore a poter mandare in rovina un gioco popolare, essa può nuocere gravemente alla sua percezione pubblica, allontanando i giocatori meno tossici e favorendo coloro il cui divertimento deriva dai confronti verbali aggressivi con gli altri.

Il più evidente effetto economico direttamente imputabile al comportamento della propria community è un calo drastico non solo dei nuovi giocatori, ma della percentuale di retention di questi nuovi giocatori.

In altre parole, non solo diventa più difficile convincere i giocatori a provare il gioco ("No io questo non lo prendo, ne ho sentito parlare male"), ma diventa ancora più difficile convincere coloro che lo provano a diventare giocatori stabili ("Mi hanno insultato fin dalla mia prima partita, io non gioco più").

Con resoconti che dimostrano che gli utenti che soffrono di tossicità in una comunità online hanno il 320% in più di probabilità di smettere, gli sviluppatori interessati alla fidelizzazione degli utenti non possono più permettersi di guardare dall'altra parte.

Chiunque si intenda di marketing è consapevole che il costo di acquisizione di un utente è di molto superiore al suo costo di retention, ovvero lo sforzo nel farlo restare un utente attivo e di non farlo smettere di giocare.

Inutile precisare che il costo di ri-acquisizione di un utente è di gran lunga il più corposo, più grosso anche del costo di acquisizione di un utente che non ha mai provato il prodotto.

Questo perché un giocatore che ha lasciato un gioco, indipendentemente dal motivo, richiede molto più lavoro di convincimento per farlo tornare a giocare, proprio perché alla base del suo abbandono spesso c'è un motivo ben preciso.

Questa singola informazione, ovvero il motivo dell'abbandono, è di estrema importanza per una software house. Vi sarete accorti che molto spesso nel momento in cui andate a sospendere un abbonamento a un servizio, vi viene chiesto di indicare il motivo della vostra dipartita.

"I miei amici hanno smesso di giocare" e "Non mi diverto più", sono tra le opzioni più popolari. Se pensate ai motivi per cui avete smesso di giocare a qualsiasi prodotto negli ultimi anni, sono certo che apparirebbero un mix di queste opzioni, unite magari al bilanciamento PvP di classi e/o campioni, inaffidabilità dei server di gioco, mancanza di tempo, e via dicendo.

Ebbene, il motivo più diffuso, con circa il 35% delle preferenze, è "Per via della tossicità della community in gioco". Più di 1 persona su 3 smette di giocare per colpa della tossicità dei giocatori intorno a loro. Questa cifra è applicabile a qualsiasi titolo con una componente competitiva online, da League of Legends a Rainbow Six: Siege.

Per farvi capire quanto è economicamente disastrosa questa problematica, prendiamo come esempio Fortnite, un gioco che ha recentemente annunciato il raggiungimento dei 250 milioni di giocatori. Di questi 250 è lecito aspettarsi che circa 80 milioni (i.e. un terzo) lasceranno il gioco per la tossicità della community.

Parliamo di 80 milioni di potenziali clienti, 80 milioni di giocatori che sappiamo passare, in media, circa 30 ore alla settimana in gioco, e che smetteranno dopo aver raggiunto il loro limite di sopportazione.

Utilizziamo delle cifre conservative e poniamo che il 5% dei giocatori totali di Fortnite siano paganti (percentuale al di sotto della media di conversion standard per un gioco free-to-play): questo significherebbe che Fortnite avrebbe perso circa 4.500.000 utenti paganti.

Sapendo che in media ogni giocatore pagante spende 5 euro al mese su Fortnite (anche questo è un numero intenzionalmente basso) e moltiplicando questo valore per il numero di utenti paganti persi, arriviamo a una stima di circa 22 milioni di euro.

22 milioni di euro di ricavi persi a causa della tossicità in gioco.

Improvvisamente tutti gli sforzi fatti dalle software house per limitare questo problema assumono un altro significato e un'altra prospettiva: non si tratta più solamente di un ritorno d'immagine o del fare la cosa giusta per i propri giocatori, motivi che comunque sarebbero validi e giustificherebbero gli sforzi in questa direzione, ma parliamo di montagne di denaro che vengono perse ogni settimana, ogni mese, ogni anno.

Analizzando il problema da una prospettiva diversa, è subito chiaro come ridurre anche solo dell'uno o due percento l'impatto della tossicità in gioco, sia un obiettivo economicamente attraente, visto che è facilmente convertibile in un ricavo economico di svariati milioni di euro.

Ecco spiegato come mai le software house sono disposte ad assumere interi team di psicologi sportivi (Riot Games), implementare da zero nuove feature con il solo scopo di ridurre la tossicità e migliorare il sistema di segnalazioni in gioco (Ubisoft), e pianificare l'intero gioco attorno alle interazioni esclusivamente positive tra giocatori e il ricompensare atteggiamenti positivi da parte dei giocatori (Blizzard Entertainment).